Nvidia unifica IA y HPC en la plataforma del servidor HGX-2

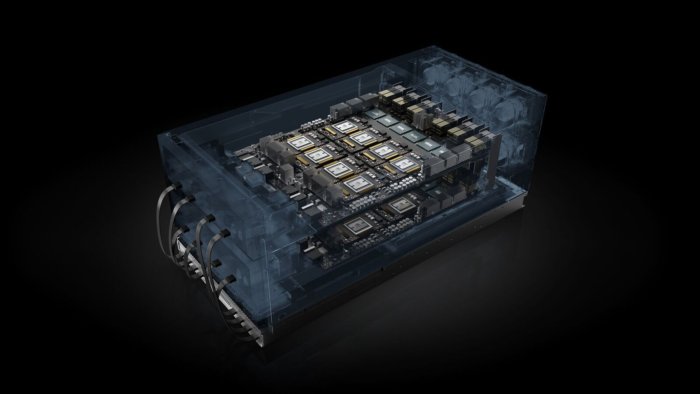

Nvidia está perfeccionando su área de negocio de rendimiento y eficiencia del centro de dato con una nueva plataforma de servidores, la HGX-2, diseñada para aprovechar la potencia de 16 Tesla V100 Tensor Core GPU para satisfacer los requisitos de cargas de trabajo de IA y de alto rendimiento (HPC) .

Los fabricantes de servidores para centros de datos Lenovo, Supermicro, Wiwynn y QCT afirman que enviarían sistemas HGX-2 antes de fin de año. Es probable que algunos de los principales clientes de los sistemas HGX-2 sean proveedores de hiperescala, por lo que no sorprende que también se espere que Foxconn, Inventec, Quanta y Wistron fabriquen servidores que utilicen la nueva plataforma para centros de datos en la nube.

El HGX-2 se construye utilizando dos placas base GPU que unen las GPU de Tesla a través de la tela de interconexión NVSwitch. Los zócalos HGX-2 manejan 8 procesadores cada uno, para un total de 16 GPU. La HGX-1, anunciada hace un año, maneja solo 8 GPU.

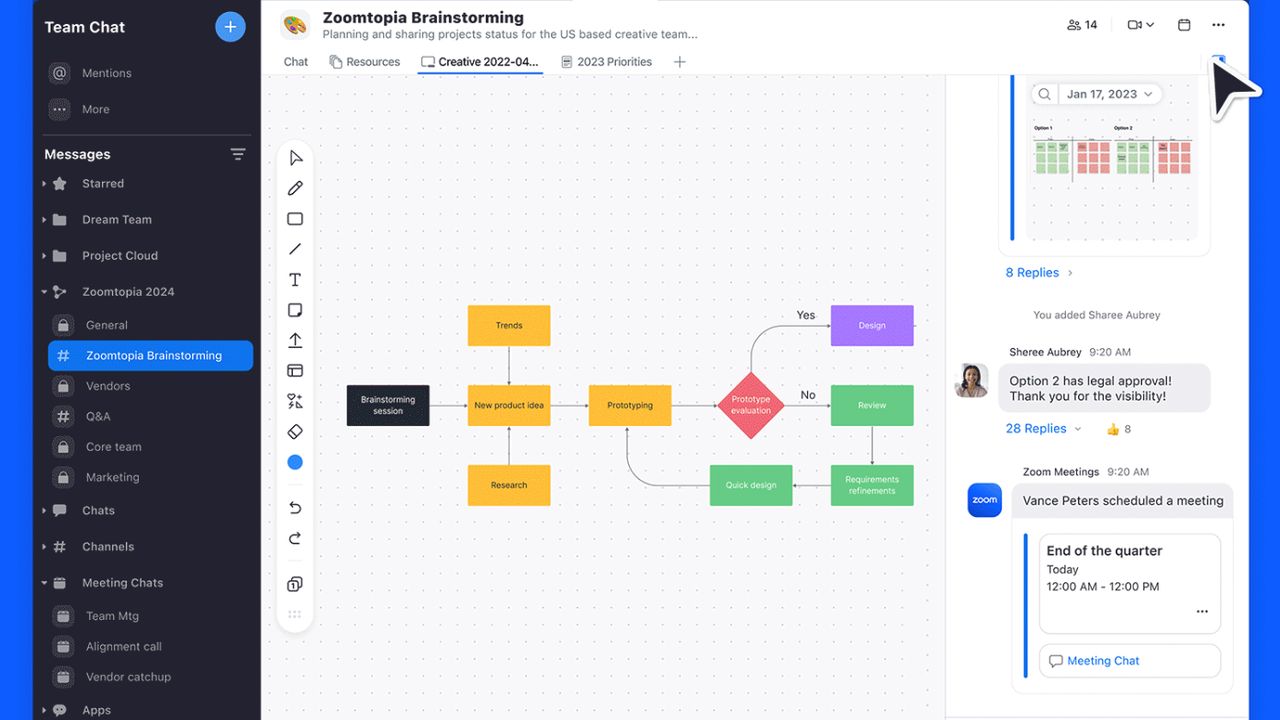

Nvidia describe el HGX-2 como un "bloque de construcción" alrededor del cual los fabricantes de servidores pueden construir sistemas que pueden ajustarse a diferentes tareas. Es la misma plataforma de sistemas en la que se basa la próxima DGX-2 de Nvidia. La noticia aquí es que la compañía está poniendo la plataforma a disposición de los fabricantes de servidores junto con una arquitectura de referencia para que los sistemas puedan enviarse a fin de año.

La plataforma de servidor HGX-2 de Nvidia es un bloque de construcción alrededor del cual los fabricantes pueden ensamblar sistemas adaptados a diferentes necesidades informáticas y de alto rendimiento. Cada placa base HGX-2 aloja seis NVSwitches que son interruptores completamente no bloqueantes con 18 puertos, de modo que cada puerto puede comunicarse con cualquier otro puerto a la velocidad NVLink completa, dijo Nvidia. NVlink es la tecnología de interconexión propia de Nvidia, que ya ha sido licenciada por IBM.