Utility Computing

La virtualización llega al centro de datos

Durante los últimos meses, Comunicaciones World se ha ido acercando en detalle a las múltiples facetas de todo este nuevo mundo, tratando de adentrar a los usuarios en sus principales aspectos. El objetivo en este caso –con el apoyo de diversas fuentes de reconocido prestigio– es dar a los usuarios una visión global del fenómeno en su conjunto que ayude a su comprensión, con independencia de que en próximas ocasiones hagamos nuevas incursiones más específicas.

Si hubiera que identificar la principal fuerza motriz que arrastrará tras de sí a las tecnologías de la información (TI) y a su industria durante los próximos años, seguro que en la lista de tendencias candidatas aparecerían las LAN inalámbricas y la Voz sobre IP, junto a las redes de área personal, las redes ópticas, las WAN basadas en la telefonía móvil de tercera generación, el reconocimiento del habla, la inteligencia artificial e incluso la nanotecnología.

Pero siendo realistas y dejando a un lado reclamos llamativos como los frigoríficos parlantes, las tostadoras IP, los teléfonos omnipotentes y las casas avezadas; si mantenemos los pies en la tierra y dejamos a un lado los enormes anchos de banda huérfanos de aplicaciones de verdad útiles; si en un ataque de sensatez nos centramos en lo que verdaderamente ya ha demostrado con creces que funciona y que aporta un valor tangible, sin necesidad de recurrir a futuribles –para los más optimistas– o a la ciencia-ficción –para los más incrédulos– , el campo de posibilidades se estrecha. Tanto que si además aplicamos criterios estrictos como la capacidad de despliegue real aquí y ahora, la potencialidad de generar ahorros cuantificables y de simplificar las tareas de TI de las empresas, transformando los centros de datos de un engullidor de dinero a un activo dinámico del negocio, sólo una tendencia quedará bajo el foco. Muchos son los campos adyacentes y tangenciales que –en inglés y en castellano– abarca, pero todos se mueven bajo un mismo concepto global: virtualización de los centros de datos, utility data center, utility computing, utility fabric, service-centric computing, grid computing, on-demand computing, autonomic computing, infraestructura adaptativa, capacidad bajo demanda, servicios bajo demanda, optimización de infraestructura... Sea cual sea el matiz que más nos atraiga, lo cierto es que estas tecnologías avanzan rápidamente e impactarán directa y trascendentalmente las infraestructuras TI corporativas.

Paso a paso

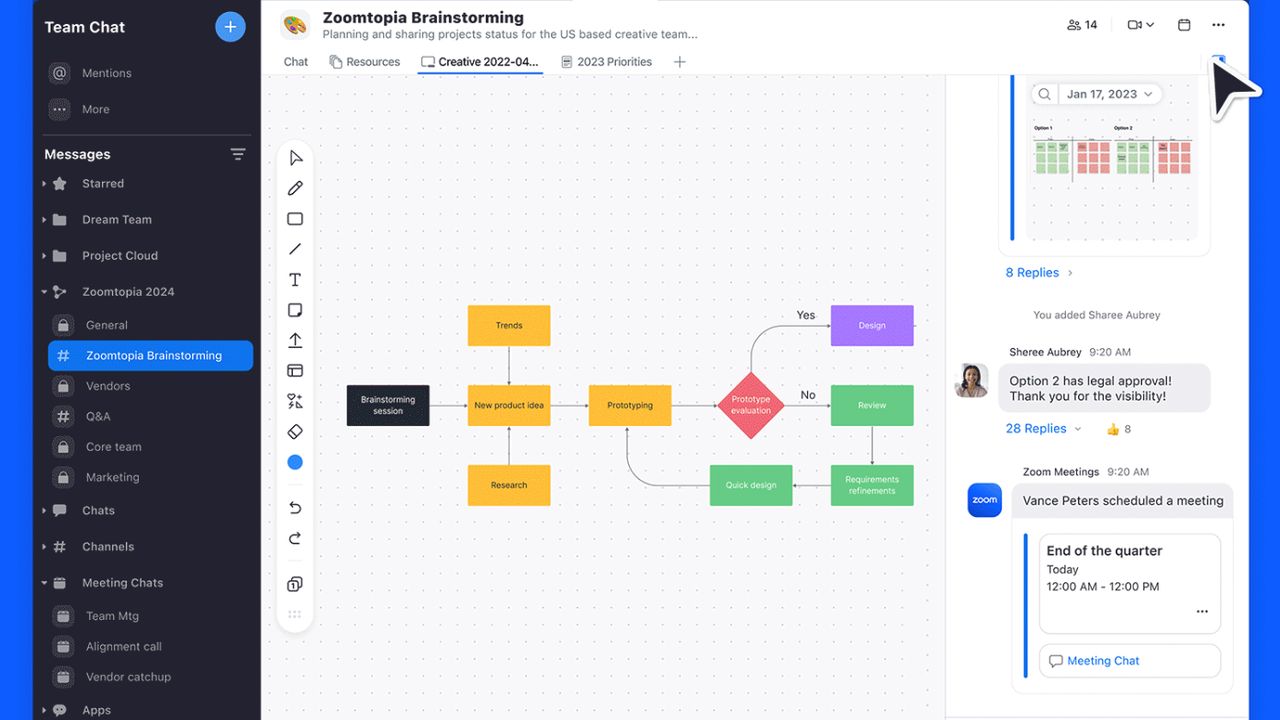

Los centros de datos actuales son como junglas de bases de datos y servidores conectados entre sí por un enredo de cables. A fin de poner orden en este creciente descontrol, los responsables TI más avispados se están dejando seducir por el atractivo de la consolidación de servidores. De hecho, se estima que un 75% de las grandes empresas abordará, de una u otra forma, un proyecto de este tipo durante 2004.

Pero éste es sólo el primer paso hacia el concepto último de “utility data center”. La siguiente fase será compartir recursos compatibles mediante técnicas como la automatización y la virtualización. Finalmente, el tercer paso consistirá en la compartición dinámica de todos los recursos del centro de datos, incluyendo la alimentación eléctrica, el almacenamiento y el networking.

Poco a poco el concepto de “utility computing” está siendo identificado como la tendencia global que hoy mueve a los centros de datos, hasta el punto de que, según los analistas, será la principal fuerza motriz del mercado TI durante la próxima década. No es de extrañar teniendo en cuenta el evidente atractivo ya explícito en su misma definición: para IDC, utility computing es “la capacidad de disponer, de un modo transparente y bajo demanda, de capacidad de computación y escalarla sin problemas geográficos y con independencia de sistemas operativos y aplicaciones”.

Más específica, la consultora Summit Strategies define la utility computing como “un pool virtualizado de recursos TI autogestionables que pueden ser suministrados y reasignados dinámicamente mediante herramientas basadas en políticas para satisfacer las cambiantes necesidades de servicio y negocio de las organizaciones”. Estos servicios pueden estar localizados en cualquier lugar y pueden ser gestionados por cualquiera, tanto por el personal TI de la empresa como por un proveedor de servicios. Además, su utilización puede ser seguida y facturada a nivel de usuario individual o de grupo.

En cifras, IDC pronostica para el mercado de utility computing un volumen de 3.600 millones de euros en 2007, partiendo de los 800 millones de euros que generará durante el presente año. La firma consultora segmenta este mercado en tres categorías: primero aparece la gestión y monitorización de sistemas y después la automatización de los centros de datos, para llegar finalmente a su completa virtualización. En 2003, el primer apartado está siendo el que mayor actividad acumula, pero en 2005 sólo representará un valor de 400 millones de euros, mientras que la automatización duplicará esa cifra, y la vir-tualización alcanzará aproximadamente 1.200 millones. En 2007, esos valores serán de 500, 1.000 y 2.200 millones de euros, respectivamente.

Panorama desolador

¿Qué es lo que todo lo anterior aporta real- mente a las empresas? La respuesta es tan clara como atractiva: estas tecnologías permiten a los centros de datos operar de forma más eficiente que ahora, tanto conceptual y topológicamente como física y estratégicamente.

El panorama actual de los centros de datos es desolador, con servidores de archivos e impresión, servidores Web, servidores de correo electrónico, servidores de aplicaciones de empresa y servidores de bases de datos, cada uno con diferentes requerimientos de actividad, backup, escalabilidad y disponibilidad. Pero esto no es todo. Cada vez que un departamento de la empresa lanza una nueva aplicación, se hace una estimación de la capacidad que se necesitará y se carga la aplicación en un nuevo servidor. Y como nadie querrá cargar la aplicación en un servidor sobrecargado para asegurar su buen funcionamiento, se tirará por lo alto con la vista puesta en las cargas pico y en futuros crecimientos, cayendo fácilmente en el sobreaprivisionamiento.

Hay más. Durante el boom de Internet, cuando muchas empresas vieron en la Web el canal de comunicación del futuro, se comenzaron a desplegar aplicaciones de misión crítica tales como e-commerce y CRM, lo que exigía enlazar los servidores Web genéricos a servidores de aplicaciones y servidores de bases de datos de back-end. Las consecuencias hoy de esos tiempos del boom son evidentes. A los servidores especializados en tareas como el soporte de las aplicaciones, transacciones y bases de datos se unen ahora los dedicados a funciones de seguridad como las de cortafuegos, sistemas de detección de intrusiones (IDS), balanceadores de cargas, cachés Web, aceler